Yapay Zeka, Daha Gelişmiş Yapay Zekalar Üretmeye Başladı

1966 yılında İngiliz matematikçi I. J. Good’un ortaya koyduğu “ultra zeki makinelerin kendilerinden daha iyi makineler tasarlama” fikri, yapay zeka araştırmalarının temel düşünce deneylerinden birini oluşturmuştu. Good’a göre bu süreç sonucunda insan zekasını geride bırakacak bir “zeka patlaması” meydana gelebilirdi. Günümüzde ise ChatGPT, Gemini, Claude ve Grok gibi büyük dil modellerinin yazılım üretiminde kullanılması, bu teorinin pratikteki ilk örneklerini ortaya koyuyor.

Kendini geliştirme adımları

Günümüzdeki sistemlerin tam bağımsız olmadığını vurgulayan araştırmacılar, mevcut modelin insanların belirlediği hedeflere göre çalıştığını, başarı ölçütlerinin yine insanlar tarafından tanımlandığını ve hangi değişikliklerin uygulanacağını insanların belirlediğini ifade ediyor. Bununla birlikte yapay zeka sistemlerinin gelecekteki modellerin geliştirilmesinde etkili bir rol oynaması bekleniyor.

Özellikle “AutoML” gibi teknolojiler, makine öğrenimi modellerinin eğitim ve optimizasyon süreçlerini otomatikleştiriyordu. Ancak büyük dil modellerinin kod yazabilme yeteneği bu süreci yeni bir aşamaya taşıdı. OpenAI, Şubat ayında GPT-5.3-Codex modelinin kendi geliştirme süreçlerinde kullanıldığını açıkladı; modelin eğitim hatalarının düzeltilmesi, dağıtım süreçlerinin yönetimi ve değerlendirme sonuçlarının analizi üzerinde çalıştığını belirtti. Anthropic ise iç kodlarının büyük kısmının artık Claude Code tarafından yazıldığını ifade ediyor.

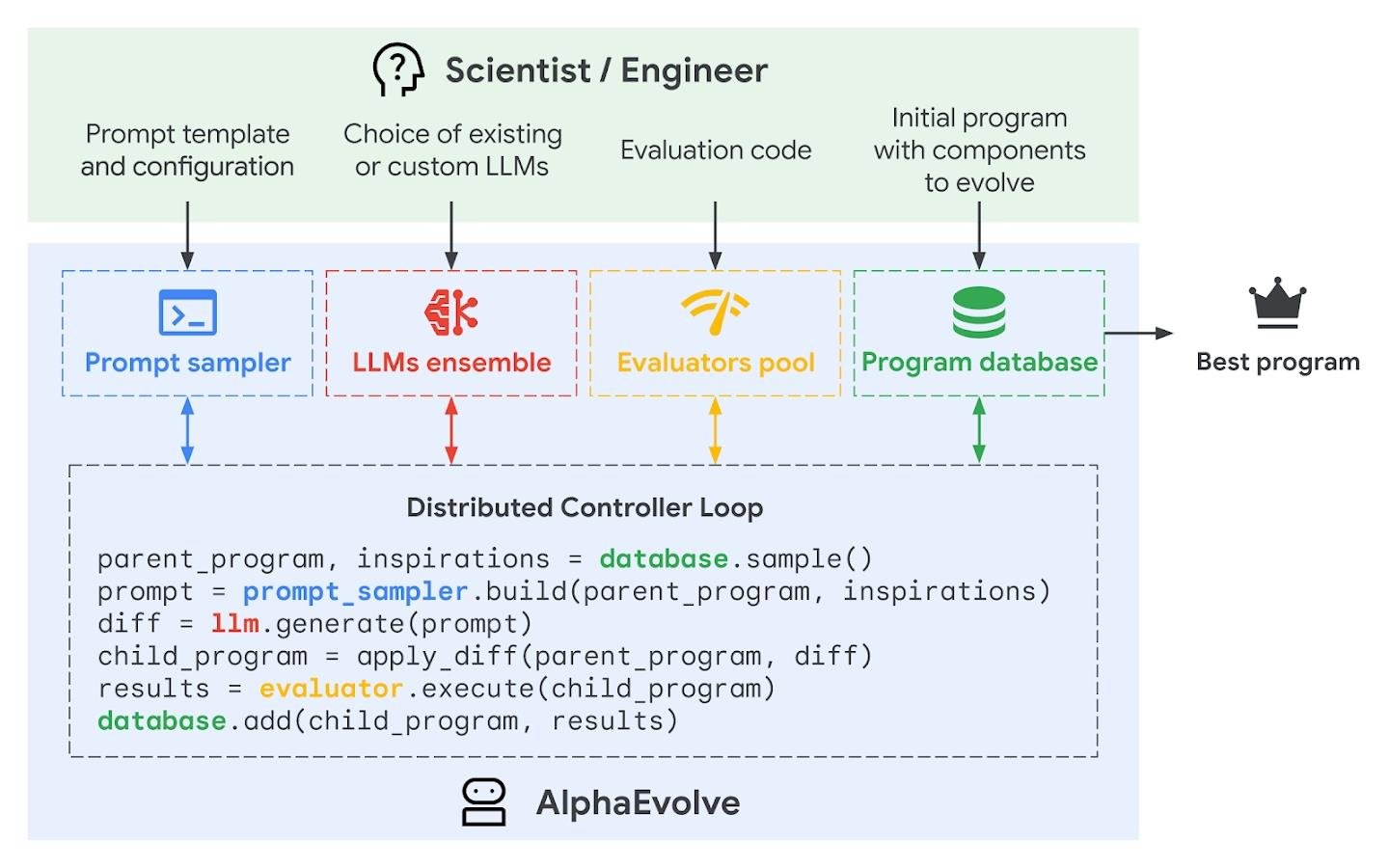

AlphaEvolve, büyük dil modellerini kullanarak yeni çözüm yöntemleri geliştiriyor, sinir ağı mimarilerini optimize ediyor, veri merkezi planlamalarını iyileştiriyor ve çip tasarım süreçlerinde yenilikçi yaklaşımlar sunuyor. Ancak bu sistem tam olarak bağımsız değil. Hangi problemleri çözmesi ve performansı nasıl değerlendireceği insanlar tarafından belirleniyor. Yine de araştırmacılar, sistemin zaman zaman insan sezgisinin ötesinde sonuçlar üretebildiğini dile getiriyorlar.

Google DeepMind araştırmacılarından Matej Balog, insanlarla makineler arasında yoğun bir işbirliği olduğunu, sistemin ortaya çıkardığı bazı keşiflerin araştırmacılara yeni perspektifler kazandırdığını belirtiyor. Balog’a göre amaç, insan sezgisinin erişemediği algoritmaları keşfetmek ve görünüşe göre ilk somut örnekler de ortaya çıkmaya başladı.

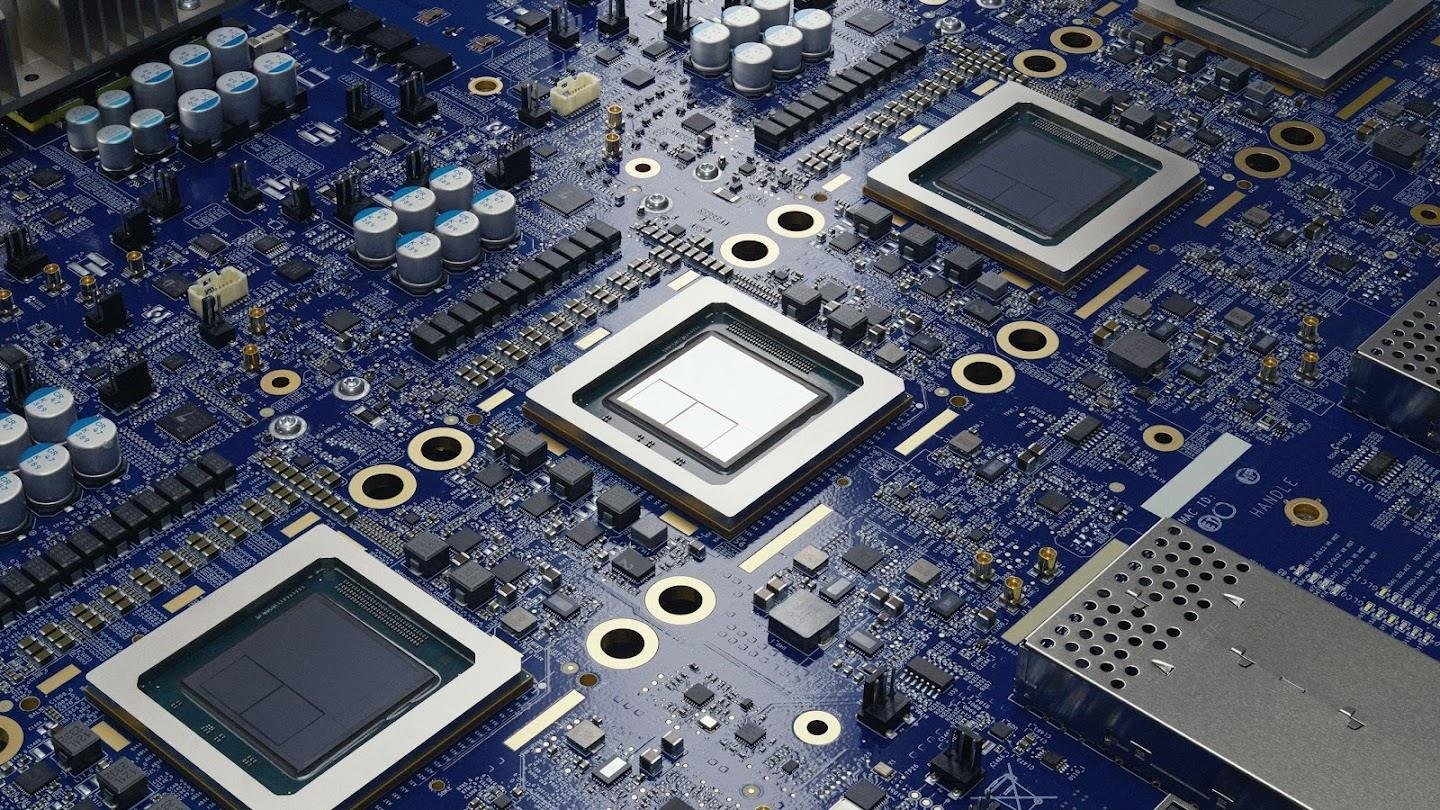

Yapay zeka çiplerini tasarlayan yapay zeka

Tam Boyutta Gör

Projede ilk aşamada insan tasarımcılara destek olunması hedefleniyor. İkinci aşamada, çip tasarım ekibi olmayan şirketler için sürecin otomatikleştirilmesi planlanıyor. Üçüncü aşama ise yapay zekanın, daha güçlü yapay zekalar eğitmek amacıyla daha iyi çipler tasarlamasını sağlamayı amaçlıyor. Bununla birlikte, şirket yetkilileri, insan denetiminin tamamen süreçten çıkarılmasının planlanmadığını vurguluyor.

Kendi kodlarını değiştirebilen sistemler

Kendi davranışlarını değiştirebilen yapay zeka sistemleri üzerine yapılan projeler de dikkat çekiyor. British Columbia Üniversitesi ve Sakana AI iş birliğiyle geliştirilen Darwin Gödel Machines (DGM) sistemi, evrimsel algoritmalar kullanarak büyük dil modeli tabanlı kodlama ajanları geliştirebiliyor. Bu sistemlerin en belirgin özelliği, kendi kodlarını değiştirebilmeleri.

Araştırma ekibi ayrıca “AI Scientist” adlı başka bir projeyi de geliştirdi. Mart ayında Nature dergisinde yayımlanan çalışma, araştırma süreçlerini otomatik hale getirmeyi amaçlıyor. Sistem, araştırma fikirleri üretebiliyor, yazılım ortamında deneyler yapabiliyor, sonuçları bilimsel makale formatında yazabiliyor ve ardından bu makaleleri değerlendirebiliyor. Bu şekilde yalnızca kodlama değil, deney ve değerlendirme süreçleri de otomatik döngüye dâhil edilmeye başlanıyor.

Endişeler yeniden gündemde

Tüm gelişmelere rağmen, araştırmacılar sistemlerin hâlâ insan seviyesinde olmadığını vurguluyor. Uzmanlar, mevcut modellerin fikir üretimi, uygulama ve değerlendirme konusunda “yeterli” düzeyde olduğunu belirtiyor. Gerçek dünyada var olan fiziksel süreçlerin de büyük bir engel oluşturduğunu ifade eden araştırmacılar, insanların sistemin merkezinde kalmaya devam edeceğini savunuyor.

Bazı uzmanlar, kontrolsüz bir yapay zeka gelişim sürecinin hâlâ mümkün olduğunu ve “zeka patlaması” ihtimalinin göz ardı edilmemesi gerektiğini düşünüyor. Şirketlerin kendi kendini geliştiren modelleri kamuya açıklamadan içlerinde tutmasının risk yaratabileceği öne sürülüyor. Araştırmacılar, ileri düzey yapay zeka laboratuvarlarının sıkı bir şekilde denetlenmesi gerektiğini, özellikle siber saldırılar ya da biyolojik silah geliştirme süreçlerinde kötü niyetli aktörlerin bu sistemlerden yararlanma olasılığının dikkatlice izlenmesi gerektiğini savunuyor.

Uzmanlara göre, gelecekteki yapay zeka ekosistemi tek bir “süper zekadan” oluşmayabilir. Bunun yerine, birbirleriyle etkileşimde bulunan çok sayıda yapay zeka ajanının oluşturduğu bir yapı ortaya çıkabilir.